در عرصه رقابت گسترده هوش مصنوعی، تمام شرکتها میکوشند تا مدلهای زبانی بزرگ (LLM) را روی مقرونبهصرفهترین سختافزارهای موجود به کار بگیرند. هرچه سختافزار ضعیفتر باشد، میزان انرژی لازم برای اجرای این مدلهای زبانی بزرگ کاهش مییابد. اما سوال اینجاست که اجرای یک مدل هوش مصنوعی روی سختافزاری که در سال ۱۹۸۲ میلادی به بازار عرضه شده، چگونه خواهد بود؟

این دقیقاً همان هدفی است که ماچیج ویتکوویاک (Maciej Witkowiak) در پروژه خود دنبال میکند. این پروژه که با نام “Llama2.c64” شناخته میشود، در نظر دارد یک هوش مصنوعی ساده را روی یک دستگاه کمودور ۶۴ اجرا کند. اگرچه این سیستم به زودی قادر به رقابت با مدل پیشرفته GPT-4o نخواهد بود، اما این اقدام همچنان یک دستاورد قابل توجه به شمار میرود.

طبق گزارش وبسایت Hackaday، ماچیج ویتکوویاک پروژه Llama2.c64 را به صورت عمومی معرفی کرده است. البته نباید انتظار عملکرد بالایی از این سختافزار قدیمی داشته باشید، اما اجرای هر برنامه روی آن به خودیخود بسیار شگفتانگیز است. در ادامه، نحوه توصیف این پروژه توسط خود ویتکوویاک آورده شده:

- این برنامه توسط Maciej ‘YTM/Elysium’ Witkowiak، با بهرهگیری از oscar64 به سیستم C64 پورت شده است.

- Llama2.c64 در واقع پورت برنامه llama2.c به کامپیوتر کمودور C64 است، به شرط آنکه این دستگاه حداقل به ۲ مگابایت حافظه REU مجهز شده باشد.

- این برنامه مدل 260K tinystories را اجرا کرده و توانمندیهای Llama2 را به سختافزار خاص C64 میآورد.

- باید توجه داشت که این یک مدل گفتگو و چت به حساب نمیآید.

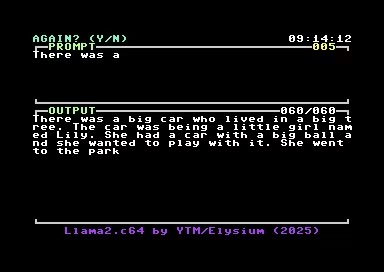

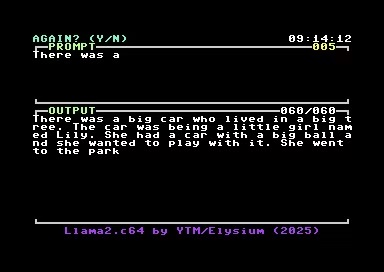

در تصویر میتوانید نمونهای از داستانسرایی Llama2.c64 را ببینید. البته، شاید در نگاه اول مانند سخنان نامفهوم کودکی به نظر برسد که در حال تعریف کردن یک داستان است، اما با در نظر گرفتن این موضوع که این هوش مصنوعی روی یک رایانهی ۴۲ ساله اجرا شده، واقعاً حیرتانگیز به نظر میرسد.

ویتکوویاک درباره مزایای این پروژه میگوید که این هوش مصنوعی تحت کنترل شما قرار دارد و روی سختافزار ضعیف کار میکند. به گفته او، «انتظار برای دریافت توکن بعدی روی C64 دقیقاً همان میزان هیجانی را دارد که انتظار برای توکنی از DeepSeek روی لپتاپ.» در مورد معایب آن نیز ویتکوویاک میگوید: «هیچ ایراد واقعی وجود ندارد، این فوقالعاده است.»

source

کلاس یوس